Tensorflow™ Inception v3-benchmark

LeaderGPU® is een ambitieuze speler op de markt voor GPU-computers, die de huidige stand van zaken wil veranderen. Volgens testresultaten is de snelheid van de berekeningen voor het ResNet-50-model bij LeaderGPU® 3 keer sneller dan Google Cloud en 2,9 keer sneller dan AWS (gegevens worden verstrekt voor een voorbeeld met 8x GTX 1080). De kosten voor het per minuut huren van de GPU bij LeaderGPU® beginnen al vanaf € 0,02. Dat is meer dan 4 keer lager dan de kosten voor het huren bij Google Cloud en meer dan 5 keer lager dan de kosten bij AWS (per 7 juli).

In dit artikel testen wij het Inception v3-model bij diensten zoals LeaderGPU®, AWS en Google Cloud. Wij zullen onderzoeken waarom LeaderGPU® het beste aanbod is onder de onderzochte opties.

Alle testen werden uitgevoerd met python 3.5 en Tensorflow-gpu 1.2 op machines met GTX 1080, GTX 1080 TI en Tesla® P 100 met geïnstalleerd besturingssysteem CentOS 7 en CUDA® 8.0-bibliotheek.

De volgende commando's werden gebruikt om de testen uit te voeren:

# git clone https://github.com/tensorflow/benchmarks.git# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2(Aantal kaarten in de server) --model inception3 --batch_size 32 (64, 128)GTX 1080-instanties

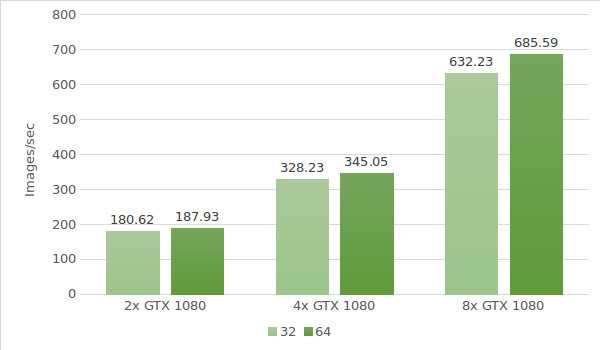

Voor de eerste test gebruiken we instanties met de GTX 1080. De testomgevinggegevens (met batchgroottes 32 en 64) staan hieronder:

- Typen instanties:ltbv17, ltbv13, ltbv16

- GPU: 2x GTX 1080, 4x GTX 1080, 8x GTX 1080

- OS:CentOS 7

- CUDA / cuDNN:8.0 / 5.1

- TensorFlow GitHub hash:b1e174e

- Benchmark GitHub hash:9165a70

- Opdracht:

# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2 --model inception3 –batch size 32 (optional 64) - Model:Inception v3

- Testdatum:juni 2017

De testresultaten zijn weergegeven in het volgende diagram:

GTX 1080Ti-instanties

Nu gebruiken we instanties met de GTX 1080 Ti. De testomgevinggegevens (met batchgroottes 32 en 64) staan hieronder:

- Typen instanties:ltbv21, ltbv18

- GPU: 2x GTX 1080TI, 4x GTX 1080TI

- OS:CentOS 7

- CUDA / cuDNN:8.0 / 5.1

- TensorFlow GitHub hash:b1e174e

- Benchmark GitHub hash:9165a70

- Opdracht:

# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2 (4) --model inception3 --batch_size 32 (optional 64, 128) - Model:Inception v3

- Testdatum:juni 2017

De testresultaten zijn weergegeven in het volgende diagram:

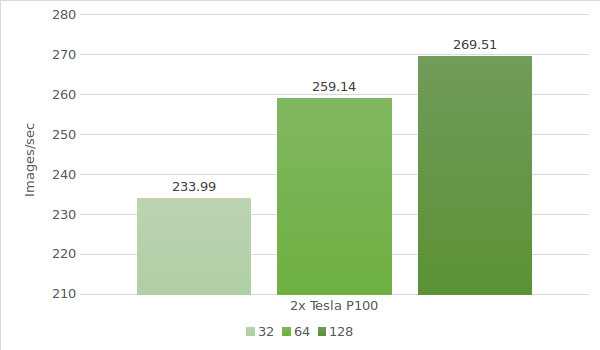

Tesla® P100-instantie

Ten slotte is het tijd om het model te testen met de Tesla® P100. De testomgevinggegevens (met batchgroottes 32, 64 en 128) staan hieronder:

- Typen instanties:ltbv20

- GPU:GPU: 2x NVIDIA® Tesla® P100

- OS:CentOS 7

- CUDA / cuDNN:8.0 / 5.1

- TensorFlow GitHub hash:b1e174e

- Benchmark GitHub hash:9165a70

- Opdracht:

# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2 --model inception3 –batch size 32 (optional 64, 128) - Model:Inception v3

- Testdatum:juni 2017

De testresultaten zijn weergegeven in het volgende diagram:

In onderstaande tabel hebben wij de resultaten verzameld van Inception v3-testen op Google Cloud en AWS (met de batchgrootte 64)

| GPU | Google cloud | AWS |

|---|---|---|

| 1x Tesla K80 | 30.5 | 30.8 |

| 2x Tesla K80 | 57.8 | 58.7 |

| 4x Tesla K80 | 116 | 117 |

| 8x Tesla K80 | 227 | 230 |

* Gegevens voor de tabel zijn afkomstig uit de volgende bronnen:

https://www.tensorflow.org/lite/performance/measurement#details_for_google_compute_engine_nvidia_tesla_k80

https://www.tensorflow.org/lite/performance/measurement#details_for_amazon_ec2_nvidia_tesla_k80

Laten we de kosten en verwerkingstijd berekenen van 1.000.000 beeld op elke machine van LeaderGPU®, AWS en Google. Berekeningen zijn beschikbaar met een batchgrootte van 64 voor alle machines.

| GPU | Aantal beelden | Tijd | Kosten (per minuut) | Totale kosten |

|---|---|---|---|---|

| 2x GTX 1080 | 1000000 | 88m 41sec | € 0,03 | € 2,66 |

| 4x GTX 1080 | 1000000 | 48m 18sec | € 0,02 | € 0,97 |

| 8x GTX 1080 | 1000000 | 24m 18sec | € 0,10 | € 2,43 |

| 4x GTX 1080TI | 1000000 | 33m 47sec | € 0,02 | € 0,68 |

| 2х Tesla P100 | 1000000 | 64m 18sec | € 0,02 | € 1,29 |

| 8x Tesla K80 Google cloud | 1000000 | 73m 25sec | € 0,0825** | € 6,05 |

| 8x Tesla K80 AWS | 1000000 | 72m 27sec | € 0,107 | € 7,75 |

** De Google Cloud-dienst biedt geen betaalplannen per minuut. De berekening van de kosten per minuut is gebaseerd op de uurprijs ($ 5.645).

Zoals uit de tabel kan worden opgemaakt, is de beeldverwerkingssnelheid in het Inception v3-model maximaal met 8x GTX 1080 van LeaderGPU®, waarbij:

de initiële kosten bij LeaderGPU® al beginnen vanaf € 1,77. Dat is ongeveer 3,42 keer lager dan bij instanties van 8x Tesla® K80 van Google Cloud, en ongeveer 4,38 keer lager dan bij instanties van 8x Tesla® K80 van AWS;

de verwerkingstijd 24 minuten 18 seconden bedroeg. Dat is 3,03 keer sneller dan bij de instanties van 8x Tesla® K80 van Google Cloud en 2,99 keer sneller dan bij de instanties van 8x Tesla® K80 van AWS.

De testresultaten laten er geen twijfel over bestaan. LeaderGPU® is een bewezen leider op het gebied van GPU-computing en biedt ongeëvenaarde oplossingen tegen redelijke prijzen. Profiteer vandaag nog van het voordelige GPU-aanbod van LeaderGPU®.