Tensorflow™ – VGG16-Benchmark

LeaderGPU® – ein revolutionärer Service, der es Ihnen ermöglicht, GPU-Computing aus einem neuen Blickwinkel zu betrachten. Die Geschwindigkeit der Berechnungen für das VGG16-Modell in LeaderGPU® ist im Vergleich zu Google Cloud 1,8-mal und im Vergleich zu AWS 1,7-mal höher (die Daten beziehen sich auf ein Beispiel mit 8 GTX 1080). Die Kosten für die Miete der GPUs in LeaderGPU® beginnen bei nur 0,02 Euro pro Minute, was mehr als 4-mal niedriger ist als die Kosten für die Miete in Google Cloud und mehr als 5-mal niedriger als die Kosten in AWS (Stand: 7. Juli 2017).

In diesem Artikel führen wir Tests mit dem VGG16-Modell in verschiedenen Diensten durch, die GPUs zur Miete anbieten, darunter LeaderGPU®, AWS und Google Cloud. Die Ergebnisse der Tests zeigen, warum LeaderGPU® das beste Angebot unter den untersuchten Optionen ist.

Alle Tests wurden mit Python 3.5 und Tensorflow-gpu 1.2 auf Rechnern mit GTX 1080, GTX 1080 Ti und Tesla® P 100 mit dem CentOS 7-Betriebssystem und der CUDA® 8.0-Bibliothek durchgeführt.

Die folgenden Befehle wurden zur Durchführung des Tests verwendet:

# git clone https://github.com/tensorflow/benchmarks.git# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2(Anzahl der Karten auf dem Server) --model vgg16 --batch_size 32 (64)GTX 1080-Instanzen

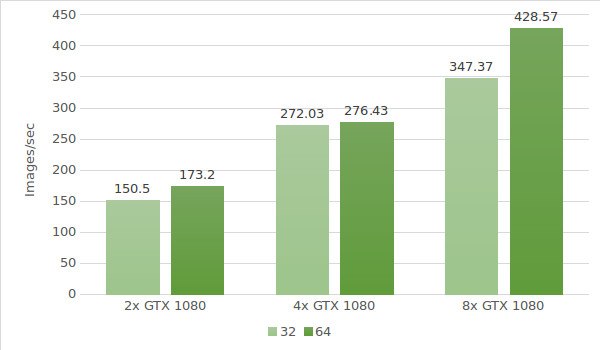

Im ersten Test verwenden wir Instanzen mit GTX 1080. Die Daten der Testumgebung (mit den Stapelgrößen 32 und 64) sind unten aufgeführt:

Testumgebung:

- Instanztypen:ltbv17, ltbv13, ltbv16

- GPU: 2x GTX 1080, 4x GTX 1080, 8x GTX 1080

- OS:CentOS 7

- CUDA / cuDNN:8.0 / 5.1

- TensorFlow GitHub Hash:b1e174e

- Benchmark GitHub Hash:9165a70

- Befehl:

# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2 --model vgg16 --batch_size 32 (optional 64) - Modell:VGG16

- Datum des Tests:Juni 2017

Die Testergebnisse sind in dem folgenden Diagramm dargestellt:

GTX 1080 Ti-Instanzen

Lassen Sie uns nun Instanzen mit GTX 1080 Ti testen. Die Daten der Testumgebung (mit den Stapelgrößen 32 und 64) sind unten aufgeführt:

Testumgebung:

- Instanztypen:ltbv21, ltbv18

- GPU:2x GTX 1080TI, 4x GTX 1080TI

- OS:CentOS 7

- CUDA / cuDNN:8.0 / 5.1

- TensorFlow GitHub Hash:b1e174e

- Benchmark GitHub Hash:9165a70

- Befehl:

# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2 (4) --model vgg16 --batch_size 32 (optional 64) - Modell:VGG16

- Datum des Tests:Juni 2017

Die Testergebnisse sind in dem folgenden Diagramm dargestellt:

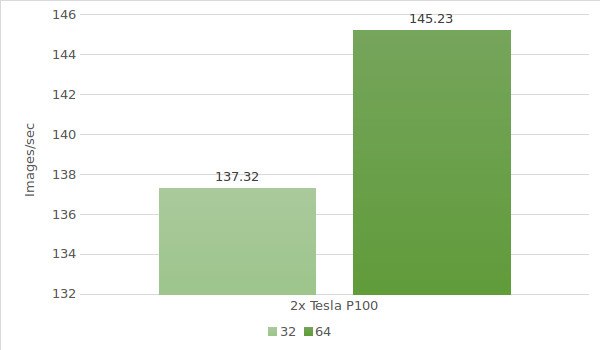

Tesla® P100-Instanz

Zum Schluss testen wir die Instanzen mit Tesla® P100. In diesem Fall sieht die Testumgebung (mit den Stapelgrößen 32 und 64) wie folgt aus:

Testumgebung:

- Instanztyp:ltbv20

- GPU:2x NVIDIA® Tesla® P100

- OS:CentOS 7

- CUDA / cuDNN:8.0 / 5.1

- TensorFlow GitHub Hash:b1e174e

- Benchmark GitHub Hash:9165a70

- Befehl:

# python3.5 benchmarks/scripts/tf_cnn_benchmarks/tf_cnn_benchmarks.py --num_gpus=2 --model vgg16 --batch_size 32 (optional 64) - Modell:VGG16

- Datum des Tests:Juni 2017

Die Testergebnisse sind in dem folgenden Diagramm dargestellt:

Die folgende Tabelle zeigt die Ergebnisse der VGG16-Tests in Google Cloud und AWS:

| GPU | Google cloud | AWS |

|---|---|---|

| 1x Tesla K80 | 35.4 | 36.3 |

| 2x Tesla K80 | 64.8 | 69.4 |

| 4x Tesla K80 | 120 | 141 |

| 8x Tesla K80 | 234 | 260 |

* Die Daten stammen aus den folgenden Quellen:

https://www.tensorflow.org/lite/performance/measurement#details_for_google_compute_engine_nvidia_tesla_k80

https://www.tensorflow.org/lite/performance/measurement#details_for_amazon_ec2_nvidia_tesla_k80

Wir berechnen die Kosten und die Verarbeitungszeit von 1.000.000 Bildern auf einem LeaderGPU®-, AWS- und Google-Rechner (die Berechnung basiert auf dem höchsten Ergebnis der einzelnen Rechner):

| GPU | Anzahl der Bilder | Zeit | Kosten (pro Minute) | Gesamtkosten |

|---|---|---|---|---|

| 2x GTX 1080 | 1000000 | 96m 13sec | € 0,03 | € 2,89 |

| 4x GTX 1080 | 1000000 | 60m 17sec | € 0,02 | € 1,21 |

| 8x GTX 1080 | 1000000 | 38m 53sec | € 0,10 | € 3,89 |

| 4x GTX 1080TI | 1000000 | 41m 29sec | € 0,02 | € 0,83 |

| 2х Tesla P100 | 1000000 | 114m 45sec | € 0,02 | € 2,30 |

| 8x Tesla K80 Google cloud | 1000000 | 71m 12sec | € 0,0825** | € 4,84 |

| 8x Tesla K80 AWS | 1000000 | 64m 6sec | € 0,107 | € 6,85 |

** Der Google Cloud-Dienst bietet keine minutenbasierten Zahlungspläne an. Die Berechnung der Kosten pro Minute basiert auf dem Stundenpreis (5,645 $).

Wie aus der Tabelle hervorgeht, ist die Bildverarbeitungsgeschwindigkeit im VGG16-Modell mit 8 GTX 1080 von LeaderGPU® am höchsten. Hinzu kommt:

Die anfänglichen Mietkosten bei LeaderGPU® liegen bei nur € 0,02 pro Minute, was etwa 4,13-mal niedriger ist als bei den Instanzen mit 8 Tesla® K80 der Google Cloud-Plattform und etwa 5,35-mal niedriger als bei den Instanzen mit 8 Tesla® K80 in AWS.

Die Verarbeitungszeit betrug 38 Minuten und 53 Sekunden, was 1,8-mal schneller ist als bei den Instanzen mit 8 Tesla® K80 in Google Cloud und 1,7-mal schneller als bei den Instanzen mit 8 Tesla® K80 in AWS.

All dies deutet darauf hin, dass LeaderGPU® viel profitabler ist als seine Konkurrenten, da dieser Dienst maximale Geschwindigkeit zu einem günstigen Preis anbietet. Mieten Sie die beste GPU mit flexiblen Preisen noch heute in LeaderGPU®!